2. 北京邮电大学, 北京 100876

2. Beijing University of Posts and Telecommunications, Beijing 100876

由于台风一般生成于开阔洋面,而海洋上观测资料稀少,特别是在台风进入雷达有效探测范围之前,台风的监测主要依靠气象卫星探测来完成。因此在台风业务预报实践中,卫星云图就成为了确定台风强度的最主要的依据,而如何通过卫星云图更准确地估测台风强度也就成为了尤为重要的课题。

这方面,目前世界气象组织(World Meteorological Organization,WMO)推荐使用的方法为20世纪70年代美国国家海洋和大气管理局(National Oceanic and Atmospheric Administration,NOAA)的Dvorak(1975)在统计经验的基础上建立的基于台风云型特征的台风强度估测技术。而经过多年业务实践,Dvorak方法也已成为各国官方机构最常使用的台风主观定强方法(许映龙等,2015)。Dvorak方法的缺点是在云特征指数的确定方面存在较大主观性,准确率依赖预报员的经验和训练,因此国外一些学者提出了客观Dvorak方法,从而减少人工操作、提高自动化程度,如ODT(objective Dvorak technique;Velden et al,1998)和AODT(advanced objective Dvorak technique;Olander and Velden, 2007)等方法,其中AODT一直在被不断改进并在国外进行业务应用。

我国早在20世纪80年代就开始探索利用卫星云图确定台风强度(方宗义和周连翔,1980;范蕙君等,1990),并制定了台风强度确定的技术流程,在业务中发挥了重要作用。2010年以后,中央气象台开始在业务中使用WMO推荐的Dvorak技术版本进行台风定强(许映龙等,2015),进一步提高了我国台风定强精度以及与其他业务中心的可比性。在客观定强方面,也有不少国内学者取得一定进展,如鲁小琴等(2014)利用热带云团对流核的相关特征,建立了估测台风强度的方法,估算精度能与Dvorak方法接近。

近年来,随着人工智能学科的广泛应用,由于其在图像识别方面的优势,如何将深度学习技术应用于气象领域的台风定强研究,受到越来越多的关注。美国最先开展了相关研究工作。Pradhan et al(2018)使用基于多层深度CNN(convolutional neural network)对台风等级进行估计,仅使用遥感云图就取得了超过当时公认最好方法的准确率和均方根误差值(RMSE);在德国,Zahera et al(2019)使用LSTM(long short-term memory)和DNN(deep neural network)对台风强度进行估计, 结合台风发生时的社会媒体信息,提升了对灾难性天气的强度估计。在台湾,Chen et al(2018)发布了一个开放数据集,提出了基于CNN强度回归的多模型融合方法,证明了深度学习技术在气象学研究中具有巨大的应用潜力。Tian et al(2019)使用分类和回归神经网络对台风强度进行更加精细的划分,证明了深度学习技术对热带气旋(TC)强度估计能力的提升。张淼等(2017)利用FY-3C微波温度计通道特征与台风强度建立统计关系估计热带气旋强度,并开展了尝试性的研究。越来越多的研究成果表明,运用深度学习技术解决台风定强问题具有巨大的应用前景(Combinido et al,2018;邹国良等,2019)。然而,由于这些工作多为针对大西洋或东太平洋飓风,使用的强度标签(真值)也都采用美国或日本发布的最佳路径。已有研究表明,采用不同机构的最佳路径作为实况参考会对台风强度误差评定结果产生较大的影响(陈国民等,2019)。因此本文将基于更匹配我国台风业务的中国气象局台风最佳路径集,采用目前人工智能领域最新发展的ResNet深度学习模型,构建一种自动、客观的台风强度估测技术,以期为我国台风业务提供应用。

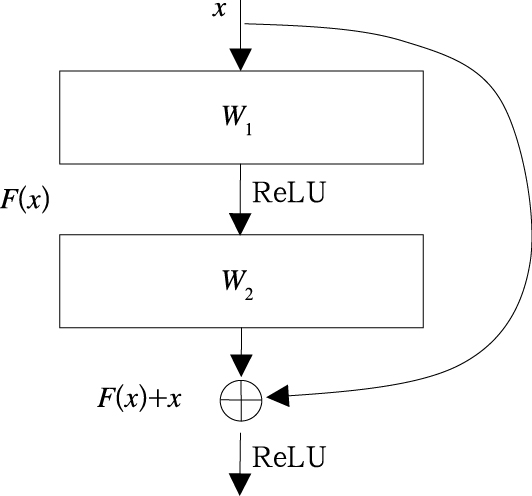

1 深度学习模型简介2015年He et al(2016)提出了ResNet,在计算机视觉(CV)领域的顶级赛事ImageNet比赛中获得第一名,之后CV领域的很多方法都建立在ResNet的基础上完成,检测、分割、识别等领域都纷纷使用ResNet。ResNet深度网络的优势为允许原始输入信息直接传到后面的层中,将在一定程度上弥补传统的卷积网络或者全连接网络的缺陷,比如在信息传递的时候或多或少会存在信息丢失、信息损耗,随着深度增加导致梯度消失或者梯度爆炸等问题。具体解决的方法就是通过ResNet网络的残差结构(图 1), 直接将输入信息旁路传到输出,保护信息的完整性,整个网络只需要学习输入、输出差别的那一部分,简化学习目标和难度。

|

图 1 ResNet的残差学习模块 Fig. 1 Residual learning module of ResNet |

图 1中:x表示输入,F(x)表示残差块在第二层激活函数之前的输出,即F(x)=W2σ(W1x),其中W1和W2表示第一层和第二层的权重,σ表示修正线性单元(rectified linear unit,ReLU)的激活函数。最后残差块的输出是σ[F(x)+x]。

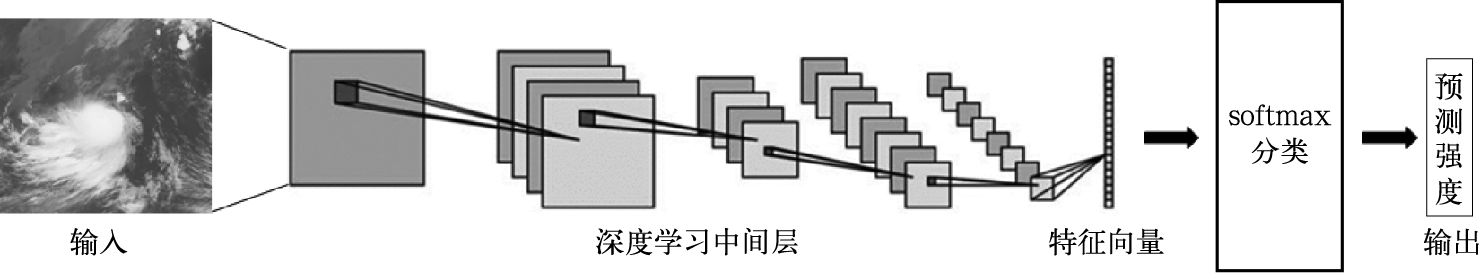

由于ResNet的这一优点,首先使用ResNet50深度学习模型,在ImageNet(Deng et al, 2009)数据集上进行训练,使其具有识别物体的基本能力,然后在最后两个卷积层进行迁移学习,这种做法被称为预训练模型(Russakovsky et al, 2015;He et al,2019)。其中,模型最后一层卷积经过平均池化生成2 048维的特征向量,代表了经过深度学习之后与台风强度有关的云图特征,该特征向量再通过一个softmax分类器,按照1 m·s-1的间隔输出预测强度及相应的概率(图 2)。

|

图 2 ResNet50深度学习模型示意图 Fig. 2 ResNet50 model diagram |

本文中所有试验均基于RedHat EL 7.6系统,模型使用TensorFlow深度学习框架,通过CUDA与cuDNN利用NVIDIA Tesla T4 GPU加速模型训练。采用的集成开发环境为Anaconda,由Python语言编写而成。

2.1 深度学习数据集准备建模所用的资料包括2005—2018年西北太平洋及南海台风卫星云图(http://weather.is.kochi-u.ac.jp/sat/GAME),水平分辨率为0.05°,根据中国气象局《热带气旋年鉴》热带气旋最佳路径资料(http://tcdata.typhoon.org.cn/zjljsjj_zlhq.html),截取对应时刻台风中心400×400像素的云图(约2 000 km×2 000 km),并按照最佳路径台风强度标注标签,共计15 730张台风云图,作为深度学习数据样本集。

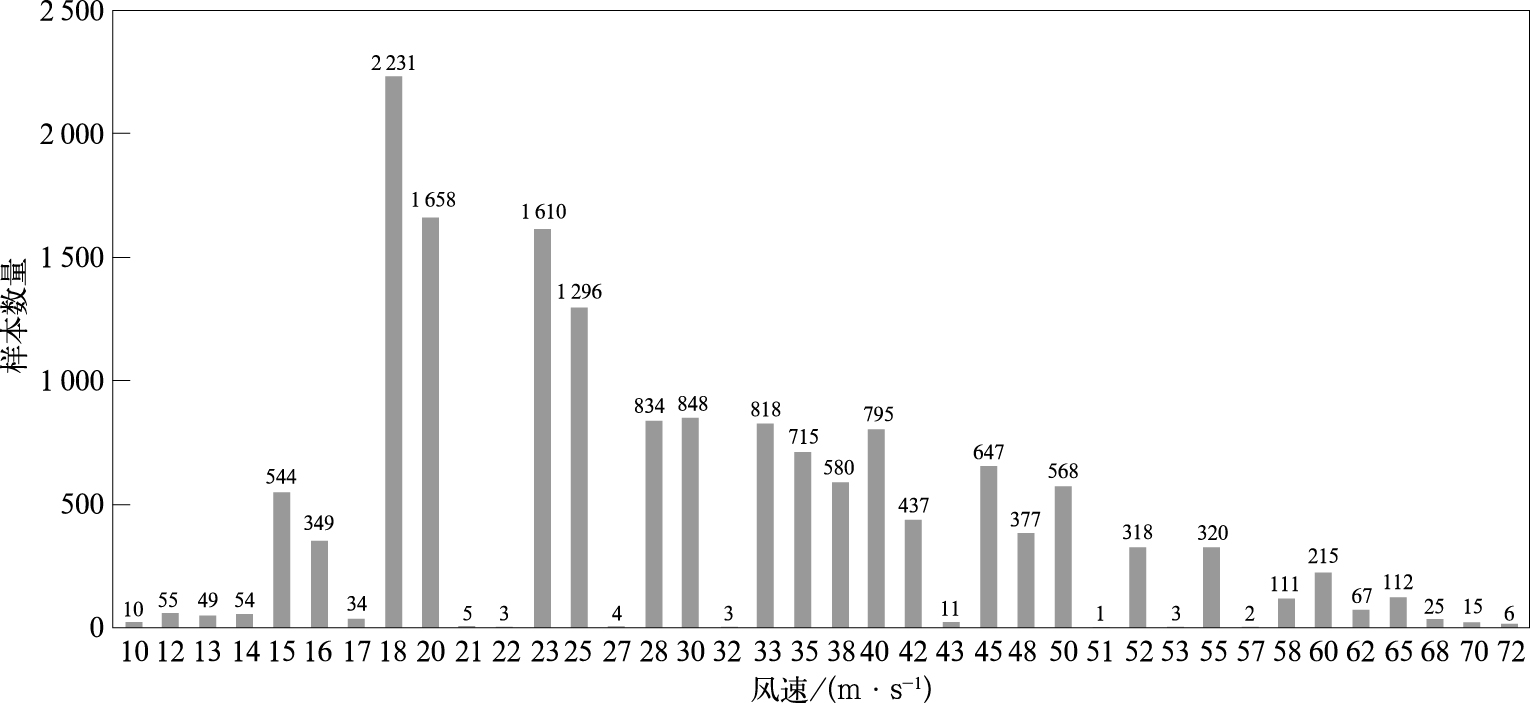

样本集数据的风速分布情况如图 3所示,可以看到各个风速的分布并不是均匀的,其中以18、20、23和25 m·s-1等风速样本最多,而较小风速(< 15 m·s-1)和较高风速(>65 m·s-1)的样本数明显偏少。因此,本文使用了机器学习中较常用的数据增强技术(Pradhan et al,2018)进行一定程度的改善,即对云图采用台风图像进行90°、180°和270°的旋转处理,通过数据增强技术增加台风样本数量。另外,个别风速的样本即使经过数据增强后仍然较少,如21、22、27和32 m·s-1等风速的样本,我们将其剔除出样本集,最终形成深度学习模型的数据集。

|

图 3 样本集中各风速的样本数目 Fig. 3 Number of samples for each wind speed in the sample set |

为了保证模型能对所有风速的台风云图特征进行学习,将每种风速均按7∶3的比例分配形成深度学习模型训练集和测试集,其中训练集用来训练模型,测试集用来检验模型的学习效果。值得注意的是,旋转后的图像需和原始图像位于同一个图像集,即若原图像存在于训练集,那么由其旋转得到的图像也应存在于训练集。最终训练集共有12 550个×4=50 200个样本,测试集共有3 138个×4=12 552个样本。

2.2 模型训练流程在ResNet深度学习网络的训练过程中,主要是通过更新网络中的每一个权重,使得最终的输出接近于真实标签值,即将整个网络的误差作为一个整体进行了最小化,从而使模型逐步拟合训练集。ResNet网络包含大量的参数,准备的训练数据集样本量对于有50层的ResNet深度学习网络建模而言是远远不够的,而在小数据集上训练会导致过度拟合,并极大地影响泛化能力。

因此,选择在预训练模型上进行迁移学习,即使用训练数据集提供给最后两个卷积层进行针对性学习,从而大大提高样本的使用率,降低学习成本。训练流程为:先使用训练集的图像和对应的强度信息不断地调整预训练网络的权重,最终使得模型的输出与真实强度值间的差异最小。模型训练的难点在于台风强度相近的图像差别非常小,人眼难以辨别。而模型要通过学习相似图像间的微小差别来判定不同的类别,需要不断地更新模型的权重,多次微调和测试不同的模型参数。

2.3 建模检验指标模型的精确度通过正确率检验,假设在n个样本中第i个样本的真值标签为Oi,模型估测标签为Si,则模型分类的正确率可以表示为:

| $ Accuracy{\rm{ }} = \frac{1}{n}\sum\limits_{i = 1}^n 1 \left({{S_i} = {O_i}} \right)i $ | (1) |

式中表示当模型的输出和真实风速值完全一致时才被认为是准确的(例如真实风速值为48 m·s-1,那么只有模型输出也是48 m·s-1,被认为是该样本估测正确)。图 4给出了训练过程中训练集和测试集的准确率变化情况,其中蓝色代表训练集上的准确率曲线,橙色代表测试集上的准确率变化情况。可以看到,随着网络训练次数不断增加,训练集的正确率一直在提升并趋近于1(接近1代表模型过拟合),而测试集的正确率当训练次数达到300次以后就趋于稳定,达到58%左右。因此,将训练300次后的ResNet模型参数确定为训练完成的模型。

|

图 4 训练集与测试集的准确率曲线 Fig. 4 Accuracy curves of training set and test set |

为了检验模型效果,这里利用训练完成的模型对测试集3 138个原始云图样本(对比表明,旋转后的样本估测结果与原样本相同)的估测结果进行了分析。一般来讲,softmax分类器输出的最大概率对应的强度即为模型估测结果,但是也注意到模型输出除了第一猜值以外,还有其余可能值及相应概率。经过比较(表 1),其中第一猜值(TOP1)的平均概率为75.3%,前两位猜值(TOP2)累计平均概率为88.8%,TOP3的累计概率就达到了94.2%,其余分类值的概率占比已经很小,可以忽略不计。

|

|

表 1 ResNet模型输出结果TOP1~TOP3的累计概率及其MAE和RMSE比较 Table 1 Cumulative probability of ResNet model outputs from TOP1 to TOP3 and the comparison of MAE and RMSE |

这里使用模型输出结果进行了三组对比分析,如式(2)所示,Ui为模型估测的第i个猜值风速,λi为第i个猜值风速相应的概率。TOP1代表使用模型输出的第一猜值作为对测试样本的定强结果,TOP2代表使用前两位猜值按概率进行加权平均后的强度值作为定强结果,同理可算得TOP3的强度值,见式(2),结果如表 1。可见,使用TOP3得到的样本估测强度的平均绝对误差(MAE)和RMSE分别为2.385 m·s-1和3.523 m·s-1,相比于TOP1和TOP2都较小,反映了更好的估测效果。

| $ TO{P_i} = \sum {\left({{U_i} \cdot {\lambda _i}} \right)} /\sum {{\lambda _i}} \;\;(i = 1, 2, 3) $ | (2) |

由于期望模型最终能在业务上应用,但建模数据与实际业务数据总是存在一定差异,而目前业务使用的卫星数据有我国的FY-4A卫星和日本葵花8号卫星,不同卫星的台风云图亮温值也存在微小的差异。考虑到葵花8号卫星的范围较好覆盖了西北太平洋所有的台风,因此这里准备了2019年西北太平洋及南海全年台风的云图(数据来源于业务接收的葵花8号卫星),经过挑选与最佳路径定强对应时刻的云图,共计596个样本,包含了2019年西北太平洋和南海的29个台风。然后利用上文训练好的深度学习模型对这些样本云图进行定强,用来检验模型对实际业务中全新未知样本的估测能力,以此评估其业务应用的前景。

3.1 2019年模型定强性能分析这里将2019年的云图样本按照最佳路径定强分成7~17级以上共12个风速等级(表 2),共包含了588个样本(另有8个6级的风速样本未包含),其中8~9级(热带风暴级)的样本数最多,之后随着风速增长,样本数基本逐渐减少,这与图 3给出的建模样本的风速分布较为相似。

|

|

表 2 模型对2019年云图台风样本的强度估计分析 Table 2 Analysis of typhoon intensity estimation of cloud images in 2019 |

首先,从强度估计的最大、最小值和中位数来看,随着台风实际风速的增长,这三个特征值也总体呈增长趋势,表明模型对不同强度的台风云图有一定的识别能力,但从模型估测的最小至最大强度跨度来看均较大,也表明模型估测中对一些样本存在较大偏差,在实际应用中需要加以注意。进一步,从中位数与各级风的风速范围比较来看,比如模型对7级样本的估测值的中位数为8级(18.5 m·s-1),说明对此类样本,模型强度估测略偏强;而模型对8~11级样本的估测则没有明显的偏差;对更高风级的样本(12级及以上),模型估测结果略有偏弱。

其次,从各风级样本的MAE和RMSE来看,模型对8~9级的样本估测效果最好,其MAE和RMSE都是最小的,其中对8级样本MAE为2.8 m·s-1、对9级样本MAE为3.3 m·s-1,其强度估测能力基本达到了可以业务参考的水平。而模型对13~16级的样本的估测效果相对较差,估测MAE在5 m·s-1以上,其中13级样本MAE达到了6.3 m·s-1,对15级样本MAE也达到了6.2 m·s-1,业务上对这类台风需要预报员加强主观分析。此外,在2019年的样本中,17级和17级以上的样本个数均不超过10个,模型对这类较强台风的强度估测能力,尚需要更多的实时资料验证。

表 2最后也给出了ResNet模型对2019年全年样本强度估测的MAE和RMSE,分别为4.3 m·s-1和5.5 m·s-1,对比Pradhan et al(2018)利用深度CNN模型对大西洋68个TC和太平洋30个TC共8 138张云图强度估测的结果(RMSE约为5.84 m·s-1),ResNet模型结果与之相比略有优势。另外,对比传统的统计学方法对云图进行强度估测的方法(鲁小琴等,2014),其独立样本的MAE和RMSE分别为5.9 m·s-1和7.7 m·s-1,本文的ResNet模型也有比较明显的优势。

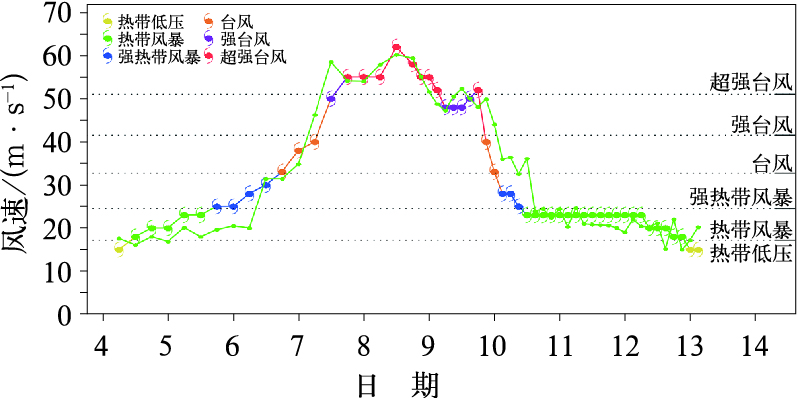

3.2 个例分析1909号台风利奇马是2019年登陆我国最强的台风,给华东及环渤海等地造成了严重风雨影响,“利奇马”于8月4日生成,10日在浙江省以超强台风级别登陆,随后北上于13日前后减弱消失。

图 5给出了“利奇马”全过程ResNet模型根据云图估计的台风强度与最佳路径强度。总体而言,模型对台风各个阶段强度的估计与实际变化均比较一致。在台风增强阶段,对台风在8月6日12时之前的强度估计略有偏弱。在台风发展阶段,能较好识别出台风在7日快速增强的过程,对台风峰值强度估计亦较为准确,特别是较为准确地估测出了“利奇马”在8日和9日的两次强度峰值。随后,10日当台风受陆地影响开始减弱,此时模型对台风强度变化存在一定的高估,也是整个台风期间模型估计偏差最大的阶段,表明ResNet模型对台风刚登陆后的快速减弱阶段强度估计偏强。最后,在台风深入内陆的阶段,虽然台风较弱,但模型对台风强度的估计与实况基本吻合。经计算,模型对1909号台风利奇马强度估计的MAE为3.5 m·s-1,RMSE为4.5 m·s-1。

|

图 5 ResNet模型对2019年8月台风利奇马模型估计的强度(绿点线)与最佳路径定强(彩色台风符号)比较 Fig. 5 Estimated intensity of ResNet model for Typhoon Lekima (green dotted line) and intensity of best track (colorful typhoon symbols) in August 2019 |

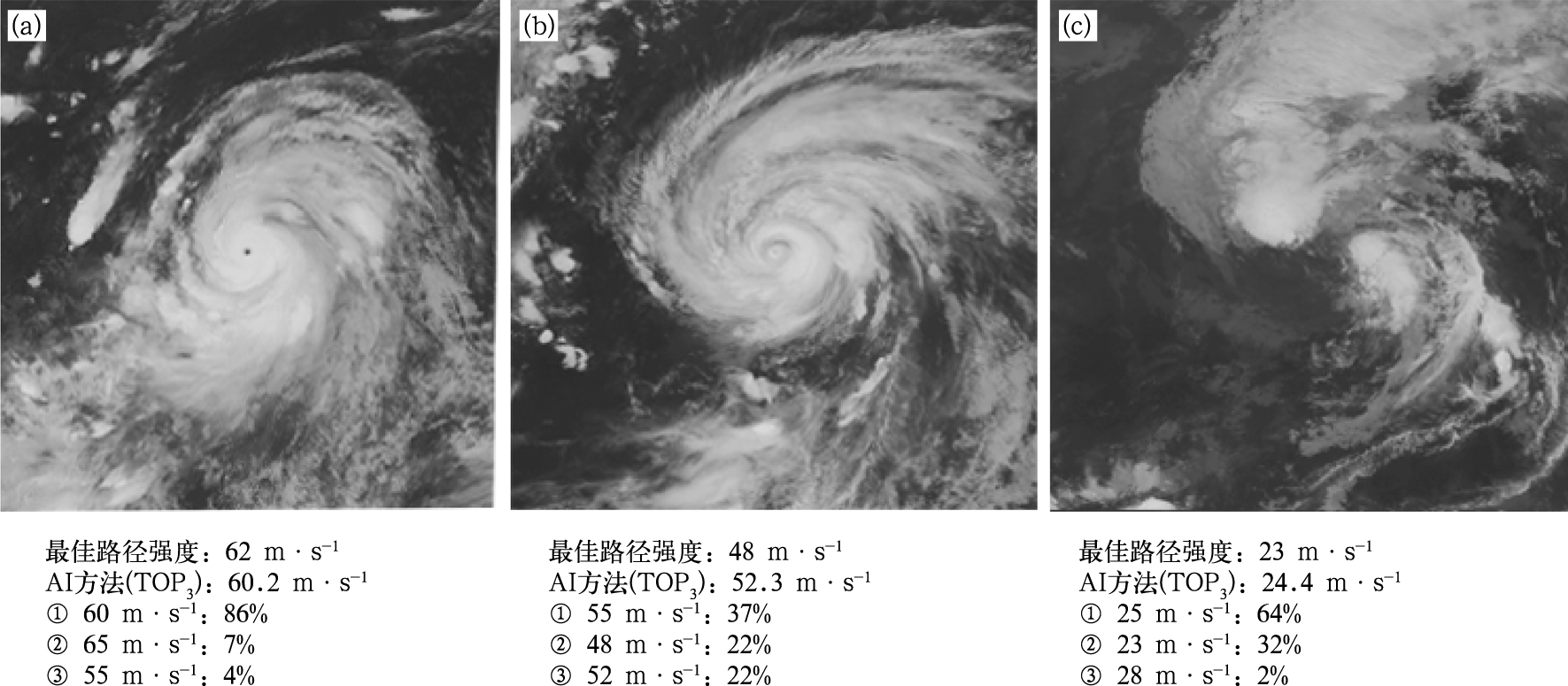

图 6给出了ResNet模型对台风利奇马三个不同时刻云图的强度估计结果,其中图 6a为“利奇马”达到峰值强度(62 m·s-1)时的云图,模型认为该时刻台风强度为60 m·s-1的概率为86%, 65 m·s-1的概率为7%以及55 m·s-1的概率为4%(该样本TOP3的概率已经近似为100%),最终模型加权平均后给出60.2 m·s-1的强度估计,与最佳路径定强非常接近。图 6b为“利奇马”达到巅峰强度后的维持阶段,与图 6a比, 云型发生较大的变化,云系从南北较为对称变成了南少北多,台风眼也逐渐开始填塞,此时模型给出的强度估计(52.3 m·s-1) 与最佳路径强度(48 m·s-1)相比略有偏强。值得注意的是,该时刻模型TOP3的概率分别为37%、22%和22%,说明模型判断时认为最可能的三个估测强度(55、48和52 m·s-1)不相伯仲,因此这一阶模型对台风结构调整期间云型的变化非常敏感,强度估测容易出现波动。图 6c是“利奇马”深入内陆后(8月11日00 UTC)的云图,此时台风云型松散,中心空心明显,但模型估计结果为24.4 m·s-1,与业务定强基本一致。

|

图 6 2019年8月(a)8日1200 UTC,(b)9日12 UTC,(c)11日00 UTC ResNet模型对台风利奇马云图的强度估计结果 (同时也给出了最佳路径定强及模型输出的TOP3估计强度及相应的概率) Fig. 6 Estimated intensity of ResNet model for Typhoon Lekima at (a) 1200 UTC 8, (b) 1200 UTC 9, (c) 0000 UTC 11 August 2019 (intensity of best track and TOP3 intensity estimation of the model as well as corresponding probability) |

本文利用ResNet50预训练深度学习网络,建立了一种基于红外卫星云图的台风定强模型,能够仅根据红外云图估测出台风强度,主要结论如下:

(1) 在深度学习模型训练数据准备中,对台风图像进行90°、180°及270°旋转等处理的数据增强技术,能够增加台风样本数量,并一定程度上改善样本数据不均衡。

(2) 在模型训练中,随着网络训练次数不断增加,训练集的准确率一直在提升,但测试集的准确率在300次以后趋于稳定,最终测试集准确率能达到58%左右。

(3) 利用该模型能够实现对不同强度、不同发展阶段的台风强度估测,且对2019年独立样本估测的MAE和RMSE分别为4.3 m·s-1和5.5 m·s-1,精度与国际水平相当,并优于传统统计方法。

该模型已经于2019年在中央气象台进行了业务测试,并当我国责任海区有编号台风时,实时给出当前台风的客观强度估测供预报员作为定强参考。从检验结果来看,模型基本能够刻画台风增强、维持到减弱各个阶段的强度变化,对预报员台风定强有一定的参考价值。不足之处是由于模型在强度估测时仅利用了单帧台风云图,同一个台风相邻时刻的估测结果有时会有较大差异,这将影响业务应用效果。因此,在下一步工作中将尝试利用多张云图改进模型,继续提高强度估测精度。

陈国民, 张喜平, 白莉娜, 等, 2018. 2016年西北太平洋和南海热带气旋预报精度评定[J]. 气象, 44(4): 582-589. |

Chen G M, Zhang X P, Bai L N, et al, 2018. Verification on forecasts of tropical cyclones over Western North Pacific in 2016[J]. Meteor Mon, 44(4): 582-589.

|

陈国民, 张喜平, 白莉娜, 等, 2019. 2017年西北太平洋和南海热带气旋预报精度评定[J]. 气象, 45(4): 577-586. Chen G M, Zhang X P, Bai L N, et al, 2019. Verification on forecasts of tropical cyclones over Western North Pacific and South China Sea in 2017[J]. Meteor Mon, 45(4): 577-586 (in Chinese).

|

范蕙君, 李修芳, 燕芳杰, 等, 1990. 确定台风强度方法的改进[J]. 气象, 16(8): 10-14. Fan H J, Li X F, Yan F J, et al, 1990. Improvements to the technique of determining tropical cyclone intensity[J]. Meteor Mon, 16(8): 10-14 (in Chinese).

|

方宗义, 周连翔, 1980. 用地球同步气象卫星红外云图估计热带气旋的强度[J]. 气象学报, 38(2): 150-159. Fang Z Y, Zhou L X, 1980. Estimation of tropical cyclone intensity by use of GMS infrared imagery[J]. Acta Meteor Sin, 38(2): 150-159 (in Chinese).

|

鲁小琴, 雷小途, 余晖, 等, 2014. 基于卫星资料进行热带气旋强度客观估算[J]. 应用气象学报, 25(1): 52-58. Lu X Q, Lei X T, Yu H, et al, 2014. An objective TC intensity estimation method based on satellite data[J]. J Appl Meteor Sci, 25(1): 52-58 (in Chinese).

|

许映龙, 张玲, 向纯怡, 2015. 台风定强技术及业务应用—以Dvorak技术为例[J]. 气象科技进展, 5(4): 22-34. Xu Y L, Zhang L, Xiang C Y, 2015. Typhoon intensity estimation technique and its operational application: with example of Dvorak technique[J]. Adv Meteor Sci Technol, 5(4): 22-34 (in Chinese).

|

张淼, 覃丹宇, 邱红, 2017. 基于FY-3C/MWTS-Ⅱ数据估计西北太平洋热带气旋强度[J]. 气象, 43(5): 573-580. Zhang M, Qin D Y, Qiu H, 2017. Estimating intensity of tropical cyclone over the Western North Pacific based on TY-3C/MWTS-Ⅱ data[J]. Meteor Mon, 43(5): 573-580 (in Chinese).

|

邹国良, 侯倩, 郑宗生, 等, 2019. 面向卫星云图及深度学习的台风等级分类[J]. 遥感信息, 34(3): 1-6. Zou G L, Hou Q, Zheng Z S, et al, 2019. Classification of typhoon grade based on satellite cloud image and deep learning[J]. Remote Sens Inf, 34(3): 1-6 (in Chinese). DOI:10.3969/j.issn.1000-3177.2019.03.001

|

Chen B, Chen B F, Lin H T, 2018.Rotation-blended CNNs on a new open dataset for tropical cyclone image-to-intensity regression[C]//Proceedings of the 24th ACM SIGKDD International Conference on Knowledge Discovery & Data Mining.London: Association for Computing Machinery: 90-99.

|

Combinido J S, Mendoza J R, Aborot J, 2018.A convolutional neural network approach for estimating tropical cyclone intensity using satellite-based infrared images[C]//2018 24th International Conference on Pattern Recognition (ICPR).Beijing: IEEE: 1474-1480.

|

Deng J, Dong W, Socher R, et al, 2009.Imagenet: a large-scale hierarchical image database[C]//2009 IEEE Conference on Computer Vision and Pattern Recognition.Miami, IEEE: 248-255.

|

Dvorak V F, 1975. Tropical cyclone intensity analysis and forecasting from satellite imagery[J]. Mon Wea Rev, 103(5): 420-430. DOI:10.1175/1520-0493(1975)103<0420:TCIAAF>2.0.CO;2

|

He K M, Girshick R, Dollar P, 2019.Rethinking ImageNet pre-training[C]//Proceedings of the 2019 IEEE/CVF International Conference on Computer Vision (ICCV).Seoul: IEEE: 4917-4926.

|

He K M, Zhang X Y, Ren S Q, et al, 2016.Deep residual learning for image recognition[C]//Proceedings of the 2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR).Las Vegas, IEEE: 770-778.

|

Olander T L, Velden C S, 2007. The advanced Dvorak technique: continued development of an objective scheme to estimate tropical cyclone intensity using geostationary infrared satellite imagery[J]. Wea Forecasting, 22(2): 287-298. DOI:10.1175/WAF975.1

|

Pradhan R, Aygun R S, Maskey M, et al, 2018. Tropical cyclone intensity estimation using a deep convolutional neural network[J]. IEEE Trans Image Process, 27(2): 692-702. DOI:10.1109/TIP.2017.2766358

|

Russakovsky O, Deng J, Su H, et al, 2015. ImageNet large scale visual recognition challenge[J]. Int J Comput Vis, 115(3): 211-252. DOI:10.1007/s11263-015-0816-y

|

Tian W, Wei H W, Xu X L, et al, 2019.Tropical cyclone maximum wind estimation from infrared satellite data with integrated convolutional neural networks[C]//2019 International Conference on Internet of Things (iThings) and IEEE Green Computing and Communications (GreenCom) and IEEE Cyber, Physical and Social Computing (CPSCom) and IEEE Smart Data (SmartData).Atlanta, IEEE: 575-580.

|

Velden C S, Olander T L, Zehr R M, 1998. Development of an objective scheme to estimate tropical cyclone intensity from digital geostationary satellite infrared imagery[J]. Wea Forecasting, 13(1): 172-186. DOI:10.1175/1520-0434(1998)013<0172:DOAOST>2.0.CO;2

|

Zahera H M, Sherif M A, Ngomo A C N, 2019.Jointly learning from social media and environmental data for typhoon intensity prediction[C]//Proceedings of the 10th International Conference on Knowledge Capture.Marina Del Rey, Association for Computing Machinery: 231-234.

|

2021, Vol. 47

2021, Vol. 47